FBI警告:詐騙犯用Deepfake遠程應聘美國公司居家辦公崗位

2022年6月28日,FBI發布公告,提醒公眾警惕在遠程求職面試中使用Deepfake技術假扮成他人的情況。

這波啊,是真的「FBI Warning」

你遠程面試的同事,可能是個假人

公告指出,FBI 互聯網犯罪投訴中心 (IC3)最近收到的用Deepfake和「被盜個人身份信息」 (PII) 申請各種遠程工作和在家工作職位的投訴有所增加。

其內容包括經Deepfake處理過的視頻、圖像或錄音,虛構事實,以假亂真。

而且按FBI公告,現在的詐騙犯工作也很用心,大都搞計算機技術業界的。

FBI表示,這些詐騙投訴與遠程技術職位有關,包括信息技術和計算機編程、數據庫和與軟件相關的工作崗位。

這些職位將允許成功過關的候選人訪問目標企業的敏感數據,包括「客戶 PII(個人身份信息)、財務數據、公司 IT 數據庫和/或專有信息」。

妥妥的信息詐騙了屬于是。

此前,早在2019年,美國國土安全部就對Deepfake技術的安全性發表質疑,稱「使用該技術騷擾或傷害他人利益的現象應當引起公眾重視」。

而遠程面試中存在的欺騙行為早已經不是啥新鮮事了。

2020年,就有領英的一位招聘人員曝出面試者「借助外部設備換臉」。

讀者也許會問:這是圖啥啊?費老鼻子勁,用詐騙手法騙到遠程在家辦公的軟件開發崗位,未必詐騙犯也要來比比誰寫代碼更卷?

哪能呢,詐騙業界要賺的是大量快錢。

要是詐騙犯成功應聘了,為了新員工遠程在家辦公,是不是要給公司內部郵箱號、公司內網登錄權限、公司基礎技術手冊這些材料?

有了這些數據,不管是轉賣換錢還是自己動手偷錢,大小都能賺一筆。要是在受害企業內網里種下后門,還可以長做長有。

2022年5月,還有面試官發現有北韓人冒充美國公民面試一些加密貨幣和Web3公司。詐騙業結合炒幣再結合諜中諜,真是好刺激。

另外,還衍生出來一個幫助他人用Deepfake等技術找到工作的業務。

果然有需求就會有市場,二階服務都有了。

詐騙破解:能,但不穩定

但Deepfake換臉并非完美無瑕,FBI官方給出了一些區分真人和Deepfake換臉的技巧,包括異常眨眼、皮膚或頭發周圍不自然的紋理與視焦,以及打光異常。

FBI技術官員稱,「在這些面試中,被采訪者在鏡頭前的動作和嘴唇運動,并不完全與說話者發出的聲音相協調。有時,咳嗽、打噴嚏或其他發聲動作,會與視覺呈現的內容不一致」。

這首先是因為,當前的 Deepfakes 難以為面部動態表情制作高置信度動畫,導致視頻中的人從不眨眼,或者眨眼過于頻繁或不自然。

這種視頻持續10秒就很惹人懷疑了,要面試全程一點破綻不露,難度頗大。

其次是打光會看起來不自然。通常,Deepfake算法會保留用作假視頻源模型的視頻短片段的光照,這與目標視頻中的匹配不佳。

還有,就是最先提到的,音頻可能看起來與假人圖像不匹配。特別是如果視頻是偽造的、但原始音頻沒有經過仔細處理的話。困擾影視業界百年的「對不上口型」難題,拿算法也無法根治。

不過,分辨Deepfake視頻的技術尚未成熟。

總部位于阿姆斯特丹的威脅情報公司 Sensity 的一份報告發現,反Deepfake的判讀算法與軟件有86%的幾率將Deepfake處理過的視頻認定為真。

2022年3月卡內基梅隆大學的研究,將市面上各種反Deepfake技術產品的算法和硬件基礎對比了下,發現準確度在30%-97%之間,浮動太大。

所以FBI在公告內文也無真正的萬靈良策對付,只有呼吁廣大科技企業作為潛在受害者,多細心核查、多留神注意。

Deepfake換頭術

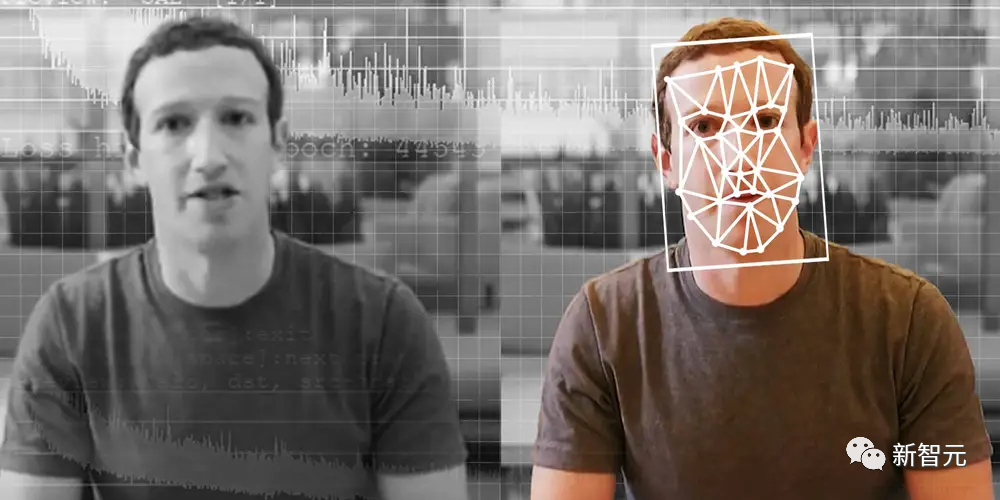

眾所周知,Deepfake就是利用生成對抗網絡(GAN)強大的圖像生成能力,將任意的現有圖像和視頻組合并疊加到源圖像和視頻上。

通過向機器學習模型輸入數千張目標圖像,Deepfake算法可以了解一個人面部的細節。有了足夠的訓練數據,算法就能預測出那個人的臉在模仿別人的表情時會是什么樣子。

經過多年的發展,現在的Deepfake技術已經發展到了毫無違和感的「實時換臉」,而且門檻極低。

比如現在市面上十分流行的「DeepFaceLive」軟件。

一鍵安裝,新手友好,換臉后還絲毫看不出破綻。

參考資料:

https://techcrunch.com/2022/06/28/this-coworker-does-not-exist-fbi-warns-of-deepfakes-interviewing-for-tech-jobs/

文章來源:新智元