NIST推出人工智能風險管理框架

從自動駕駛到網絡購物,人工智能技術已經滲入數字社會的各個角落,但是人工智能的網絡安全和風險管理卻相對滯后,NIST推出的人工智能風險管理框架期望能夠解決這種“風險差距”。

今天,企業和政府組織正在快速擁抱如雨后春筍的人工智能(AI)應用程序,提高自動化程度和運營效率,提供精準購物建議、信用審批、圖像處理、預測性警務等等服務。

與任何數字技術一樣,AI可能會受到一系列傳統安全漏洞和其他新興問題的影響,例如隱私、偏見、不平等和網絡安全問題。為了更好地管理與人工智能相關的風險,美國國家標準與技術研究院(NIST)目前正在開發一個自愿框架,全稱是:人工智能風險管理框架(AI RMF)。該框架的目標是將可信度考慮納入人工智能產品、服務和系統的設計、開發、使用和評估的能力。

NIST希望AI RMF風險框架能夠覆蓋其他領域沒有的,AI獨有的風險,并可用于繪制超出框架的合規性考慮因素,包括現有法規、法律或其他強制性指南。

誰應該關注AI風險管理框架

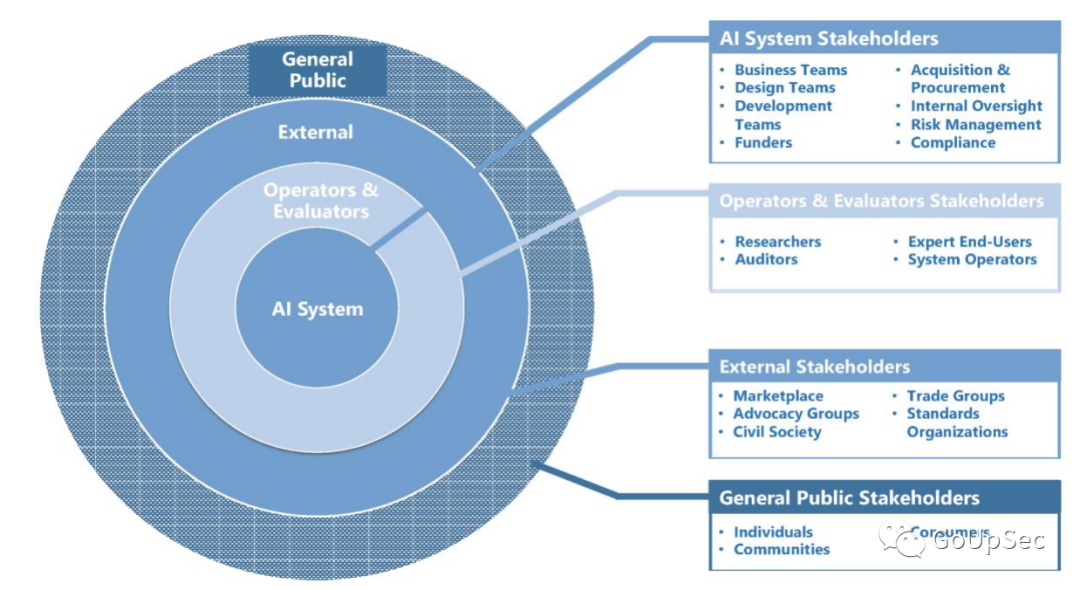

NIST將AI RMF框架的目標受眾劃分為四個利益相關者群體(上圖):

- 人工智能系統利益相關者

- 運營商和評估者

- 外部利益相關者

- 公眾

在識別和管理與AI系統相關的風險的綜合方法中,NIST使用了三類特征分類法:技術特征、社會技術特征和指導原則:

- 技術特性是指AI系統設計人員和開發人員直接控制的因素,可以使用標準評估標準來衡量,例如準確性、可靠性和彈性。

- 社會技術特征是指人工智能系統在個人、群體和社會環境中的使用和感知方式,例如“可解釋性”、隱私、安全和管理偏見。

- 指導原則是指更廣泛的社會規范和價值觀,表明社會優先事項,例如公平、問責制和透明度。

與其他NIST框架一樣,AI RMF核心包含AI風險管理活動的三個元素:功能、類別和子類別。這些功能被組織用于映射、衡量、管理和治理人工智能風險。盡管AI RMF原計劃通過配置文件為特定用例提供上下文信息,但該任務以及計劃中的實踐指南已被推遲到以后的草案。

人工智能風險治理各自為政

雖然大量科技企業正在開發、銷售和部署人工智能技術,但很少有企業關注人工智能的風險治理政策。bnh.ai的科學家Patrick Hall表示,在大型消費金融機構和其他一些高度監管的領域之外,人工智能大多在沒有正式風險治理規范的情況下被使用,因此企業(用戶)只能自行解決這些暴風雨般的治理問題。”

微軟首席人工智能官Natasha Crampton表示:“當你的治理方法過度分散時,就注定會出現失敗模式。在這種情況下,團隊希望將AI模型部署到生產中,但他們只是采用自己的流程和結構,幾乎沒有(風險治理方面的)協調。”

富國銀行執行副總裁兼企業模型風險負責人Agus Sudjianto也強調AI風險管理離不開高層管理。“如果AI項目負責人沒有高層的聲望、通道和支持,那將是行不通的。”

埃森哲首席云計算技術官Teresa Tung強調,所有企業都需要專注于人工智能。“全球2000強公司中約有一半在財報電話會議中報告了人工智能技術應用。這(人工智能風險管理)是每個企業都需要意識到的事情。”

與NIST開發的其他風險管理框架(例如網絡安全框架)一樣,最終的AI RMF可能對私營和公共部門產生廣泛的影響。目前AI RMF還處于草案的意見征詢期,截止日期為2022年4月29日。

AI RMF草案下載地址:

https://www.nist.gov/system/files/documents/2022/03/17/AI-RMF-1stdraft.pdf