再見!谷歌翻譯……

就在這兩天,有網友突然發現谷歌翻譯用不了。

(雖然谷歌退環境了,但翻譯一直是能用的)

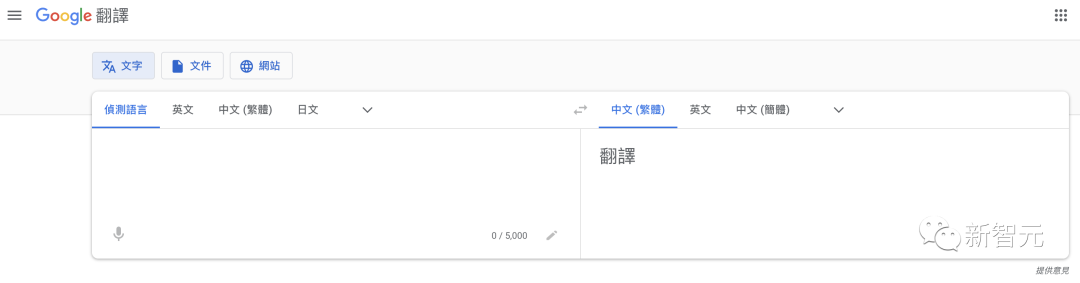

具體來說,本應提供翻譯功能的translate.google.cn,被替換成了一個所謂的「搜索頁面」。

就是長下面這樣的:

那么問題來了,谷歌不是早就退出了么,哪兒來的搜索?

沒錯,因為這就是個「截圖」而已……

不管你點擊哪里,都會直接被重新定向到谷歌翻譯的香港域名——translate.google.hk。

顯然,這個對于大陸的用戶來說,是無法訪問的。

于是,不管是谷歌Chrome內置的翻譯功能,還是其他調用了這一接口的軟件,比如KOReader(一種文檔查看器),都祭了……

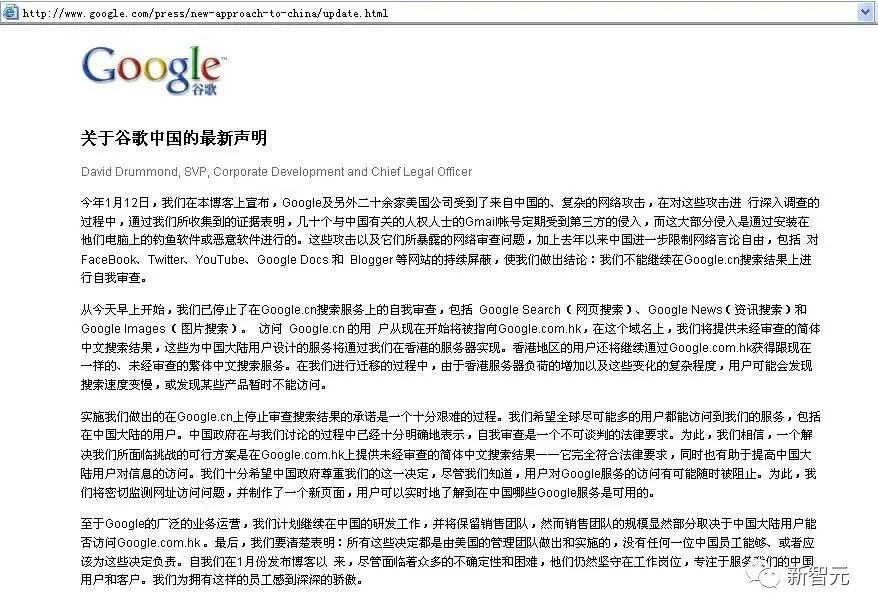

順便一提,谷歌2010年退出中國內地市場。

時任工業和信息化部部長李毅中同年3月12日在回應「谷歌退出中國事件」時說,中國的互聯網是開放的,進入中國市場就必須遵守中國法律。

此前曾有報道稱,谷歌在2018年和2019年都曾嘗試過在中國大陸重新啟動搜索服務。

作為「蜻蜓計劃」的一部分,該項目將對搜索結果進行審查,并記錄用戶的位置以及他們的互聯網瀏覽歷史。

但據The Intercept報道,在經歷了由內部隱私團隊牽頭的沖突之后,谷歌徹底放棄了這一計劃。

曾陷「辱華」風波

去年11月,有網友發現谷歌翻譯會將一些艾滋病相關的詞翻譯為中國侮辱性詞匯,引發對谷歌翻譯的反感和憤怒。

在英翻中的英文對話框輸入「新聞」,「傳播」等詞匯,中文部分顯示的仍然是「新聞」和「傳播」。

但在英文對話框輸入「艾滋病毒」等類似詞匯,中文翻譯就會顯示惡毒攻擊中國的詞匯。

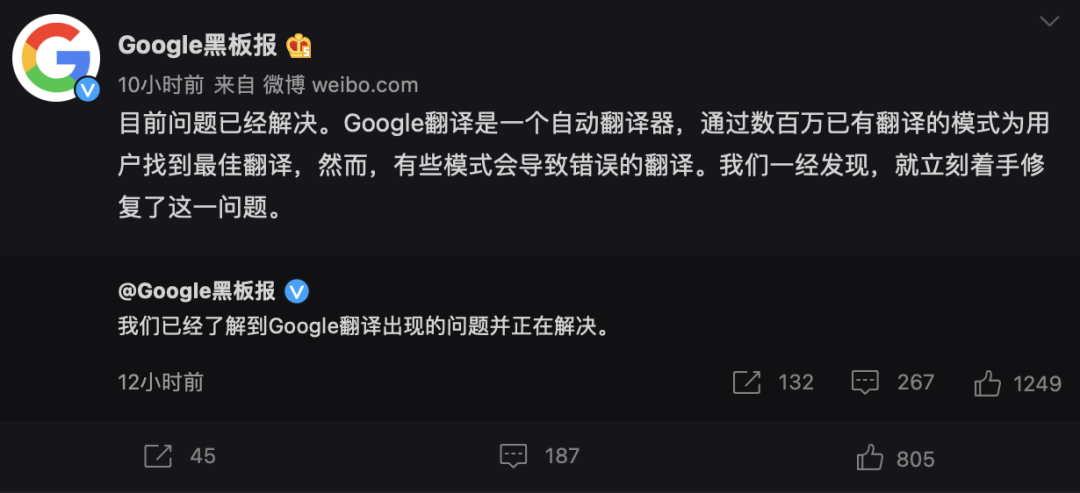

不過,谷歌很快便在微博上表示,問題已經得到了解決,并解釋稱是由「模式」引發的。

也就是說訓練語料要背大鍋,如果訓練語料存在夾帶私貨的情況,那翻譯結果也不會準確。

對此,「NeX8yte」指出,國際互聯網上中文的語料大部分并不掌握在我們自己手里,而且此類結果很可能是經過了中介語言,從而也就放大了錯誤。

銀藍劍6H17也表示,這種結果的出現一方面是機器學習用了臟語料,讓部分中文輸入也可以輸出翻譯結果,另外一方面就是模型到API的調用階段管理出現了真空。

「曹哲的雜貨鋪」認為這是有意制造的:

為什么恰好會有人找到谷歌翻譯,又恰好翻譯這些并不常用的詞語,又雙叒叕恰好把忽略系統建議硬把源語言設成「英文」呢?

輸入一段中文,然后硬告訴程序這是英文,讓他把這玩意「翻譯」成中文,其直接后果無非就是程序被你玩炸了,程序會認為這條「英文」它不會翻譯,這時候只要有心人把這個用漢語寫成的「冷門英文單詞」在翻譯社區提交翻譯建議,就很容易達成這種結果。

參考資料:

https://tcrn.ch/3E6HC3b