人工智能(AI)和機器學習(ML)技術的進步獲得了廣泛關注,據尼爾森諾曼集團(Nielsen Norman Group)估計,人工智能工具可能會將員工的生產力提高66%,這使得各地公司都想利用這些工具來提高工作效率。但相關專家警告稱,人工智能的使用可能會產生一些負面后果,包括產生不準確的結果、數據泄露和盜竊。

那么,企業如何在不影響安全性的情況下使用這些強大的AI/ML工具呢?下面,我們將討論人工智能工具可能帶來的風險,并提供8個安全利用AI工具的技巧,以幫助企業盡可能安全地利用這些工具。

人工智能工具的風險

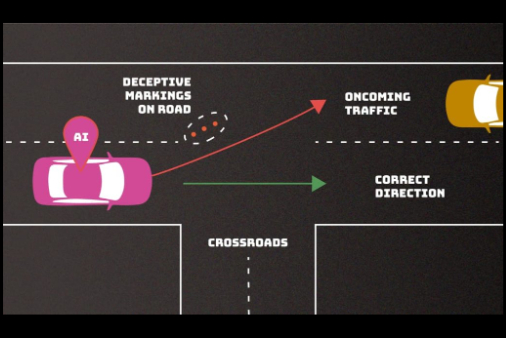

本質上來說,AI/ML只是大規模的統計數據。所有人工智能模型都依賴于數據來統計地生成其關注領域的結果。因此,大多數風險都圍繞著上述數據,尤其是機密或敏感數據,使用外部AI/ML工具的公司數據可能會意外泄露或有被竊取知識產權的風險。此外,使用錯誤數據的人工智能工具將產生不準確的結果。

幸運的是,許多人工智能工具非常強大,只要采取一些預防措施,就可以安全地使用。

安全利用AI工具的8個技巧

技巧1:記住,免費的產品可能代價沉重

如果您使用免費的人工智能工具或服務,那么您有理由懷疑它可能會利用您提供的數據。許多早期的人工智能服務和工具(包括ChatGPT)都采用了類似于Facebook和TikTok等社交媒體服務的使用模式。雖然不花錢使用這些網站,但卻是在分享自己的私人數據,這些公司會利用這些數據來定位廣告和盈利。同樣地,一個免費的人工智能服務可以從您的設備上收集數據,并保留您的提示信息,然后用這些提示來訓練它的模型。雖然這看起來沒有惡意,但您永遠不知道人工智能服務將如何從您的數據中獲利。如果該公司遭到入侵,威脅行為者可能會訪問您的數據。

技巧2:簽訂法律審查協議

要了解人工智能工具或服務如何處理您的數據,請閱讀供應商的最終用戶許可協議、主服務協議、條款和條件以及隱私政策。這些冗長而復雜的文件通常使用籠統的語言來模糊供應商可能如何使用您的數據,因此公司律師應該審查這些文件。您的法律部門了解保護您的敏感數據(包括個人身份信息)的法規要求。他們可以熟練地解釋這些文件,并在任何條款危及您的數據時提醒您。

技巧3:保護內部數據

使用外部人工智能工具的一個簡單風險是,員工(有意或無意)可能與該工具共享敏感或機密數據,從而導致數據被濫用。為了減輕這種威脅,公司必須確保對可以訪問機密或敏感數據的人員應用最小特權原則。不幸的是,一些組織沒有充分阻止員工訪問他們職責以外的公司數據。如果您限制員工只訪問他們需要的精確數據,就可以最大限度地減少他們可能泄露給外部人工智能工具的數據量。

技巧4:檢查設置并考慮為隱私付費

無論人工智能工具或服務是免費的還是付費的,它們通常都有額外的隱私設置。有些工具可以設置為不存儲提示數據。檢查您的人工智能工具的隱私設置,并將它們配置為您的偏好。此外,雖然免費工具可能保留使用您數據的權利,但您可以支付許可費以獲得提供更多保護的人工智能工具的企業版本。這些工具通常包括不使用數據和保持數據分段的功能。

技巧5:驗證AI工具供應商的安全性

在采用任何新的外部工具或服務合作伙伴時,驗證供應商和供應鏈安全性應該是您的默認實踐。數字供應鏈漏洞證明,供應商可能成為維護安全的最薄弱環節。因此,第三方風險管理(TPRM)產品和流程對信息安全至關重要。在使用人工智能工具和服務合作伙伴時,正式的TPRM流程必不可少。

技巧6:利用本地開源AI框架和工具

免費且友好的在線外部人工智能工具的可訪問性帶來了風險,為確保數據隱私,請考慮避免使用外部工具。另外,您也可以自己部署和創建一些免費的AI框架和工具。這些框架需要更多的人工智能和數據科學專業知識,因此它們可能需要您投入一定的成本。

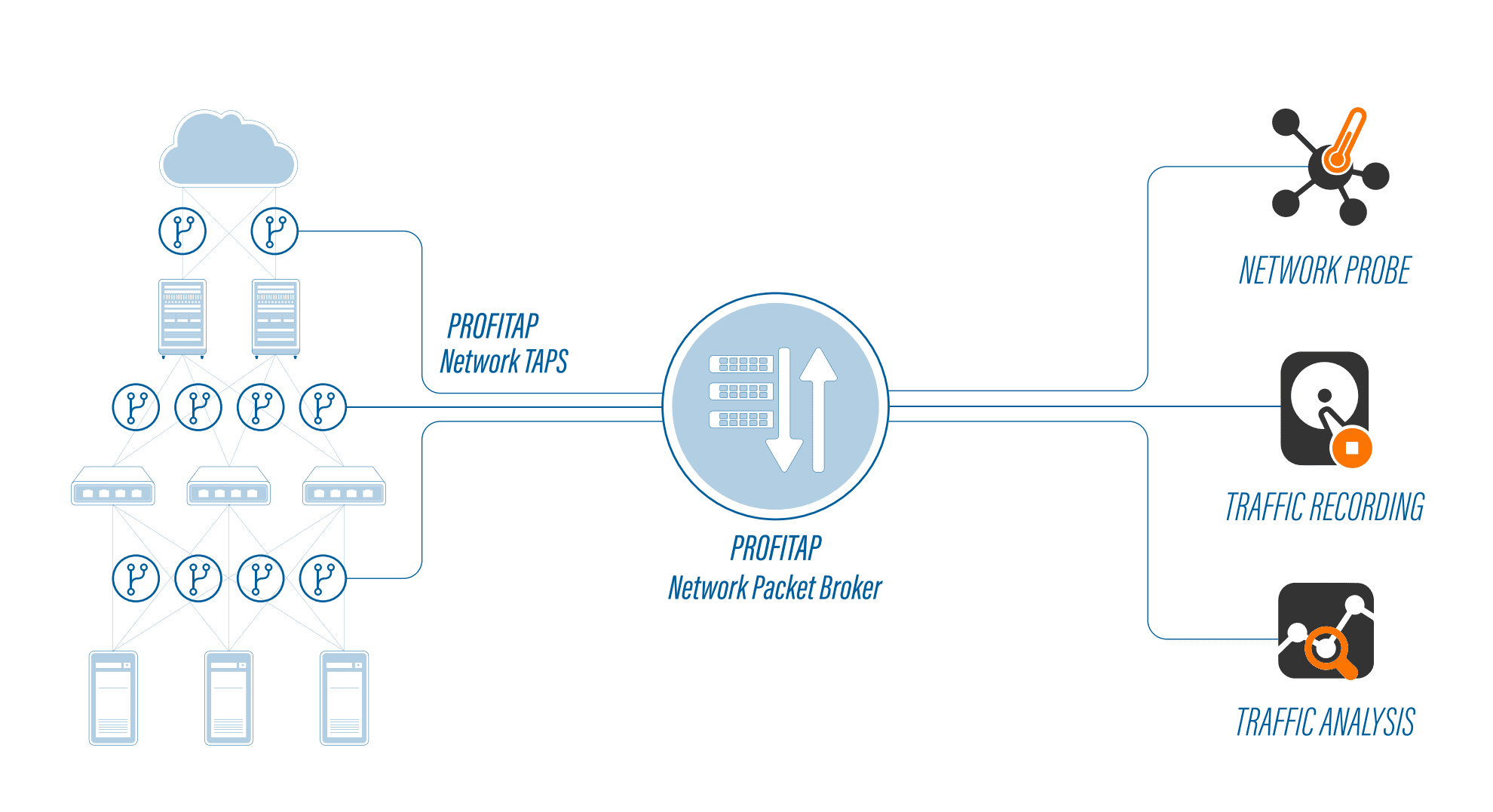

技巧7:跟蹤公司的人工智能使用情況

很難跟蹤員工使用的每個資產、軟件即服務(SaaS)工具或數據存儲,因為云和Web服務使每個人都可以使用基于Web的工具。基于人工智能的SaaS產品也是如此。監控員工使用哪些外部人工智能工具,如何使用,以及使用哪些數據,審計和記錄人工智能使用情況,作為購買流程的一部分。在確定所使用的所有內部和外部AI工具后,您可以更好地了解所面臨的風險。

技巧8:創建AI政策并提高風險意識

在安全領域,一切都始于政策。企業面臨的風險取決于企業的特定任務和需求,以及企業所使用的數據。處理公共數據的公司可能面臨較低的數據共享風險,并允許寬松的人工智能政策,而處理機密事務的公司將對外部人工智能工具的數據使用有嚴格的規定。最后,必須要根據公司的需求制定一項人工智能政策,且一旦制定了這一政策,就要定期和員工溝通與人工智能工具相關的風險。

結語

人工智能工具可以利用快速簡單的結果,從而提供巨大的商業利益,但同時也帶來了潛在的風險,我們可以通過采取一些預防措施來安全地利用人工智能工具。

Anna艷娜

Anna艷娜

X0_0X

X0_0X

X0_0X

X0_0X

007bug

007bug

一顆小胡椒

一顆小胡椒

ManageEngine卓豪

ManageEngine卓豪

上官雨寶

上官雨寶

Anna艷娜

Anna艷娜

Anna艷娜

Anna艷娜

虹科網絡安全

虹科網絡安全

Andrew

Andrew