美國 OpenAI 公司 2022 年發布的生成式人工智能(AIGC)產品 ChatGPT,憑借擁有高質量文本內容的輸出能力,能夠精確、高效地完成分析、翻譯、撰寫代碼等工作,引發了廣泛關注。大國在人工智能的賽道上已經展開了激烈的角逐,以便搶占未來新興技術的制高點和主導權。盡管此類人工智能應用能夠為社會工作帶來極大的幫助,但是,在這背后,人工智能技術的發展和應用所帶來的安全風險同樣成為國際社會關注的焦點話題。可以說,人工智能的顛覆性特征及其發展現狀凸顯了監管和治理的緊迫性。因此,在保障人工智能健康穩定發展的同時,更加需要認知其帶來的風險,并思考人工智能治理的路徑和措施。

一、認識人工智能的技術、應用和擴散風險

隨著人工智能技術的突飛猛進,各界對人工智能的關注度也日益提升,尤其是人工智能的顛覆性作用以及由此而來的安全風險,引發多方探討。當前,人工智能的安全風險可以概括為技術、應用和擴散三個方面。

(一)技術層面的數據和隱私安全風險

人工智能技術的進步很大程度上得益于數據挖掘技術的進步。人工智能算法的實現是通過對數據進行挖掘、訓練和學習,使人工智能模型能夠做出更加精準的分析和決策。然而,在數據隱私安全方面,人工智能既存在算法“黑箱”的缺陷,也存在虛假數據和數據泄露的問題。首先,算法“黑箱”是指用戶可以獲得人工智能提供的相應信息,而無法知曉算法內部的運轉機制。因此,算法往往在用戶面前是不透明的,用戶也就無法確認算法機制是否存在偏見、錯誤及其他安全問題。其次,虛假數據容易引發人們對人工智能的擔憂。訓練人工智能模型的數據集來源存在虛假的可能,而這類數據會對算法造成影響,從而導致人工智能模型在開展分析和決策時得出錯誤的結果。再次,由于人工智能需要不斷地對數據進行學習,客觀上意味著對數據安全提出了更高的要求。數據在政府部門、企業及第三方機構之間的存儲和流動是數據安全的關鍵。在此過程中,網絡攻擊、設備毀壞、人員操作不當等都容易造成數據泄露,因此會給國家和企業帶來嚴重的安全風險。

(二)應用層面的人工智能軍事化風險

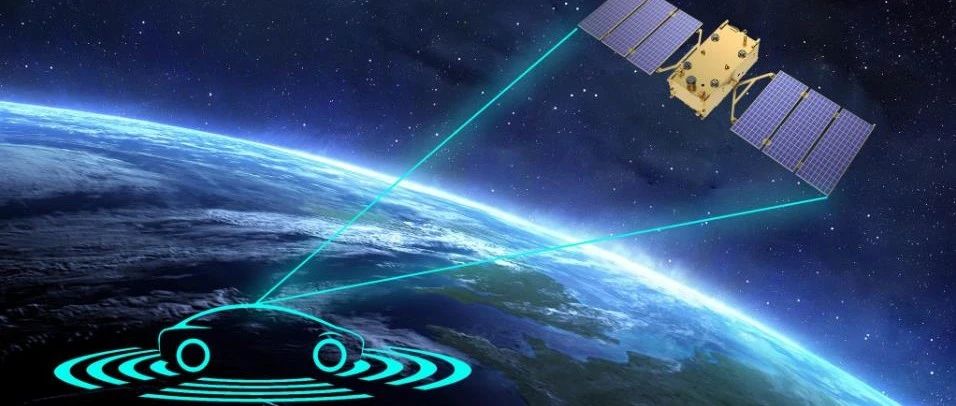

任何技術創新往往都具有“雙刃劍”的特性,新技術的突破更是離不開其在軍事領域的首先應用。互聯網最早起源于美國的阿帕網,被率先運用于軍事部門,目的是加強部門間軍事信息的交流與共享。人工智能作為新的兩用技術,具有顯著的顛覆性特征,通過智能化的態勢感知、戰場情報分析、輔助決策和自主武器系統的使用,能夠對戰爭造成非對稱的影響。這種鮮明的特性能夠以較低的代價獲得更高的收益,從而使武裝力量更加推崇和依賴人工智能技術。盡管人工智能的軍事化應用存在顛覆性的特征,但是它還可能引發誤傷平民和非軍事目標的人道主義風險、人工智能系統穩定性風險以及加劇持續沖突的戰略風險。值得注意的是,即便如此,在人工智能發展的關鍵技術上,任何一方都不想處于受制于人的局面,故而,各方都不斷加大人工智能研發投入。因此,人工智能的軍事化應用或許會引發該領域的軍備競賽,具有陷入“安全困境”的風險。

(三)擴散層面的人工智能濫用風險

從目前情況看,生成式人工智能取得了較大的發展,尤其是類似 ChatGPT 這樣的人工智能應用具有很強的便利性,可以使個人用戶通過網絡連接接入,從而增加了不同地區用戶使用該程序的數量。盡管人工智能技術的擴散會提高生產生活效率,但是,更需要注意的是這類技術被非國家行為體濫用和非法使用問題。美國智庫中東媒體研究所(MEMRI)針對其國內恐怖主義威脅監測(DTTM)項目發表了報告《全球新納粹和白人至上主義者都關注人工智能——政府予以關注的新的國家安全威脅——其目的包括招募人員、騷擾少數群體和犯罪活動,包括黑客攻擊銀行、推翻政府、攻擊基礎設施、促進游擊戰和使用大規模殺傷性武器》(Neo-Nazis AndWhite Supremacists Worldwide Look To Artificial Intelligence(AI) – A National Security Threat In The Making To WhichNo Government Is Paying Attention – For Purposes SuchAs Recruitment, Harassing Minorities, And Criminal ActivityIncluding Hacking Banks, Overthrowing Government,Attacking Infrastructure, Promoting Guerilla Warfare, AndUsing WMDs)。報告顯示,世界各地的新納粹分子、白人至上主義者和其他極端分子正在使用人工智能工具,達到實施犯罪活動目的。其中,報告提到,極端分子會使用 ChatGPT 找出美國關鍵基礎設施最容易受到攻擊的位置。報告還指出,極端主義分子使用人工智能用于策劃恐怖襲擊,包括制造大規模殺傷性武器。就人工智能可能引發恐怖威脅方面,北約于 2021 年 10 月發布的《北約人工智能戰略》(Artificial Intelligence Strategy for NATO)警告,人工智能是“新興的顛覆性技術”之一,無論是在軍事上還是對民間社會,它代表來自國家和非國家行為者的新威脅。由此可見,憑借其易操作性和智能性,人工智能在不斷擴散中增大了極端主義、恐怖主義的風險。

二、人工智能發展帶來競爭和監管挑戰

當前,作為未來技術的關鍵節點,人工智能正引發新一輪的國際競爭。中美在人工智能領域開展全面競爭;人工智能的顛覆性特征和俄烏沖突正在加速人工智能軍備競賽;人工智能的擴散加劇,黑客群體和恐怖主義分子都積極學習和使用這項新技術,使人工智能監管面臨挑戰。

(一)人工智能領域的技術競爭

算法、算力和數據構成了人工智能發展的三個核心要素。當前,國家間圍繞人工智能技術的競爭主要圍繞這三個方面。其中,中美在人工智能領域的全面競爭較為激烈。尤其是美國從算法、算力和數據方面均向中國施加壓力。通過渲染人工智能的“泛安全化”概念,美國動用制裁工具打壓中國的人工智能企業。美歐則在跨境數據流動方面展開持續博弈。

在算法問題上,中美展開了激烈的角逐。中美兩國各自均擁有眾多專注于人工智能研究的大型科技公司。然而,美國動用單邊手段打擊在此領域的中國企業。一方面,美國指控在美國國內廣泛流行的中國應用程序存在算法的不透明性,要求其實現算法安全與公開透明。例如,短視頻應用 TikTok因算法問題被美國多個州和社區起訴,被指控TikTok 的算法嚴重影響未成年人安全和公共安全。另一方面,美國以所謂的算法技術侵犯人權為由,打壓中國的人工智能公司。自 2019 年以來,美國已多次以侵犯人權為借口對中國人工智能公司實施制裁,限制美國企業同其進行貿易和投融資活動。

數據安全成為人工智能領域競爭的焦點。人工智能技術的背后是數據問題。數據的安全和流動引發了國家間博弈。在中美之間,美國認為 TikTok的數據隱私保護極不安全,擔心其會搜集用戶的個人信息和敏感數據進并被中國方面訪問。同時,美國無視其母公司字節跳動對數據本地化所做出的努力,堅持認定該應用帶來的數據安全威脅。這種所謂的“擔憂”使美國在 TikTok 問題上態度嚴苛,關于剝離、出售甚至是全面禁用 TikTok 的輿論不斷。

美歐也就數據跨境流動展開了博弈。歐盟向來重視立法層面的建章立制。以《通用數據保護條例》(GDPR)為首的數據立法體現了歐盟在數據領域的嚴格立場,對數據流動施加限制。美國則依據大型科技公司的市場力量,推動數據的自由流動。此外,歐盟以違反數據流動規則為由在 2023 年 5 月對美國科技巨頭 Meta 開出了 12 億歐元的天價罰單。可見,在這一問題上,雙方均想掌握數據流動的主導權,這也預示著美歐博弈仍將持續。

芯片出口管制成為算力競爭的主要表現。高制程芯片具有更強的算力,構建了人工智能重要的物理層基礎。美國圍繞芯片出口管制,妄圖拉開中美在人工智能領域的差距。美國在 2022 年 10 月發布出口管制新規,專門將人工智能芯片作為對華出口管制的新方向。新規則對用于人工智能領域的先進芯片、軟件以及用于生產先進芯片的各種半導體制造設備的對華出口提出了前所未有的許可限制。受新規則的影響,英偉達(Nvidia)等美國芯片公司無法繼續向中國出口其半導體產品。由此可見,在人工智能發展的方向上,美國妄圖通過單邊制裁的方式,遏制中國在該領域的發展,維護其自身的全球主導地位。

(二)人工智能領域的軍備競賽

人工智能以其智能化的特性和改變戰爭規則的潛力已經吸引了一些國家或地區加大投入,以期實現該技術的軍事化應用。一方面,美國等西方國家憑借技術優勢積極研發人工智能的軍事用途,搶占軍事技術的制高點以期在未來的戰爭中取勝。另一方面,俄烏沖突加速了各方對人工智能武器的使用,進一步推動了人工智能領域的軍備競賽。

自 ChatGPT 發布以來,美國已經對人工智能的軍事用途給予高度關注。2023 年 1 月,美國國防部(DoD)更新了關于開發和部署自主與半自主武器系統的指令,包括那些使用人工智能技術的武器系統。隨后,美國軍方在演習時開始使用生成式人工智能,幫助美軍模擬應對未來可能的沖突威脅。同時,美國還在呼吁公共和私營部門在維持美國人工智能領導地位方面積極發揮作用。

以色列在人工智能技術軍事化方面已經做好同其他全球大國角逐的準備。2023 年 2 月,以色列國防軍宣布,該部隊已開始在行動中使用人工智能。此類新技術在 2021 年為期 10 天的行動中成功鎖定了至少兩名哈馬斯指揮官。以色列國防部總干事埃亞勒·扎米爾(Eyal Zamir)在 2023 年 5 月表示,以色列的目標是成為“人工智能超級大國”,推進研究自主戰爭和簡化作戰決策。以色列還將在國防部內組建專門的軍事機器人組織,為相關研究和開發提供更高的預算。

俄烏雙方在沖突中使用了具有人工智能技術的自主武器系統,加劇了沖突的烈度,也引發其他國家對人工智能武器的興趣。在沖突中,俄烏雙方均投入了大量的無人機系統,在飛行、瞄準和打擊方面提供了人工智能增強的自主能力。同時,俄烏沖突也成為西方國家自主武器的試驗場。他們通過向俄烏沖突前線投入新研發的武器系統,得到戰場使用反饋。這也表明,西方軍火提供商對人工智能軍事化投入將有增無減。

(三)人工智能領域的監管問題

當前,國際社會對人工智能技術的擴散缺乏有效的管控,使人工智能的擴散和濫用趨勢加速。由于人工智能產品的易操作性,導致大多數人都能夠較為便捷地使用這類產品,這也讓犯罪分子有了可乘之機。例如,黑客和恐怖組織都可利用生成式人工智能為其開展威脅活動提供幫助。這種情況凸顯對人工智能監管的缺失,尤其需要從技術層面加強對人工智能特定算法和高質量數據的訓練,防止此類技術被犯罪分子用于危害公共安全的活動。

一方面,像黑客這樣的技術群體在人工智能使用方面具有更多的優勢,能夠利用新技術的特性從事更多的惡意網絡活動。通過利用人工智能,網絡犯罪分子可以創建深度偽造數據、惡意軟件以及隱秘攻擊等武器。網絡安全供應商超越身份(BeyondIdentity)在 2023 年 7 月發布了《ChatGPT 的黑暗面:網絡專家警告人工智能將在2023年輔助網絡攻擊》(ChatGPT's Dark Side:Cyber Experts Warn AI WillAid Cyberattacks In 2023)。這份報告對 1010 名網絡安全專家進行了關于人工智能輔助網絡攻擊的調查。調查發現,75% 的專家表示,人工智能在網絡攻擊中的使用數量正在增加,其中,有六分之一的受訪者經歷過人工智能推動的網絡攻擊。

另一方面,恐怖主義分子也積極獲取并學習人工智能技術發動極端主義行動。在互聯網發展普及后,恐怖主義分子一直利用網絡宣傳恐怖主義思想、策劃恐怖襲擊。人工智能逐漸成為恐怖分子進行技術學習的新方向。2022 年 12 月,在“伊斯蘭國”(ISIS)恐怖組織運營的 Rocket.Chat 平臺,一名用戶發帖稱,他使用 ChatGPT 詢問“如何最好地建立哈里發國”。在得到 ChatGPT 一系列回答后,該用戶聲稱,這表明它“比大多數活動人士更聰明”。

三、對人工智能治理的思考

人工智能帶來的風險是全世界普遍面臨的問題,各國應該圍繞人工智能安全風險,共同應對挑戰,從而引導人工智能技術發展真正造福于人類社會。

(一)加強人工智能的敏捷治理

過去的治理模式更多的是回應式治理,是在新的事物發展一段時間后,對其產生的一系列問題和影響做出事后反應。人工智能作為一項變革性技術,其創新更為迅速、影響更為深刻,這使回應式治理模式已經不能滿足這項新技術的發展要求。

敏捷治理(Agile Governance)這一概念最早來源于《敏捷軟件開發宣言》(Manifesto for AgileSoftware Development),是由包括肯特·貝克(KentBeck)、邁克·比德爾(Mike Beedle)、阿里·范·本尼庫姆(Arie van Bennekum)等在內的十七位軟件從業者共同提出的。提出這一概念的最初目的是發現更好的軟件開發方法。2018 年,世界經濟論壇正式提出了敏捷治理的方法。根據世界經濟論壇的定義,敏捷治理的概念旨在改變第四次工業革命中政策的產生、審議、實施和執行的方式。在敏捷治理的模式下,政府應與私營部門開展緊密的合作,實現敏捷治理的要求。敏捷治理的優勢主要體現在其應對人工智能技術變化的反應更為快捷和靈活,能夠及時地適應技術需求并制定合理的治理設計。敏捷治理模式將會推動技術研究和創新、行業標準和監督、問題的解決方案、長遠規劃。因此,在人工智能技術的發展中,敏捷治理可以更好地適應這一技術需求。

當前,已有一些國家積極推行人工智能的敏捷治理。加拿大、丹麥、意大利、日本、新加坡、阿聯酋和英國在經合組織(OECD)和世界經濟論壇(WEF)聯合組織的小組會議上簽署了《敏捷國家憲章》(Agile Nations Charter)。該文件被認為世界上第一個“敏捷國家”協議。該協議強調簽署國將以敏捷治理為原則,促進各國間新興技術合作與發展的潛力。在 2023 年 5 月召開的 G7 峰會上,“七國”就人工智能和新興技術治理的五項原則達成一致,其中包括敏捷治理原則。

(二)強化多利益攸關方的治理參與

當前,以大型科技公司為主的非政府實體掌握了更多的技術主導權,能夠在技術研發和投融資方面發揮重要影響。人工智能的治理過程更是需要技術社群、私營部門、科研機構等多利益攸關方的參與。

一方面,多利益攸關方代表了不同群體對技術治理的需求和看法。人工智能治理是多利益攸關方共治的開放體系。不同群體能夠分別從技術、安全、法律、規范、標準、道德等多個維度共同討論具體的治理議題。例如,在人工智能安全風險問題上,自 ChatGPT 升級到第四代之后,包括特斯拉總裁馬斯克、蘋果聯合創始人史蒂夫·沃茲尼亞克在內的 1000 多位高科技人士呼吁所有人工智能實驗室立即暫停比 GPT4 更強大的人工智能系統訓練至少6 個月,直到為此類系統制定出共享安全協議。多利益攸關方的治理參與模式,能夠提高人工智能發展過程中的安全性和包容性。

另一方面,多利益攸關方原則能夠加強政府與非政府之間的治理合作。在多利益攸關方的治理進程中,政府方面能夠聽取社會各界關于人工智能安全與發展的意見。這將有利于制定相關政策和立法。尤其是在處理數據和算法問題上,雙方的合作能夠有助于確保數據的質量、安全性,消除算法偏見并保證公平性。

(三)建立行之有效的國際治理機制

人工智能所帶來的風險挑戰是值得各國共同應對的。2023 年 7 月 18 日,聯合國安理會在聯合國總部舉行了人工智能會議。安理會秘書長安東尼奧·古特雷斯(António Guterres)呼吁設立一個全球監管機構監督這項新技術。可見,對構建人工智能治理機制的討論正在引起國際社會的高度關注。該機制的治理對象應涵蓋以下幾個方面。

一是在技術研發角度注重保護整體的系統性安全。確保人工智能的數據、算法等方面的安全,需要從整體入手。無論是軟件還是硬件或兩者,都應確保人工智能系統的透明度、問責制、驗證和審計安全協議。系統性安全還將有助于保護數據要素。同時,在技術研發的過程中,需要著重加強監管算法“黑箱”,明確算法開發者的責任,確保算法的公平性與合法性。

二是在應用角度討論人工智能的軍事化用途。為防止人工智能的軍事應用進一步加劇,國際社會應該加強人工智能軍備控制的磋商,遏止人工智能的戰爭用途。其中,需要注意的是,軍事化問題涉及國家間信任,對該問題的探討將是艱難持久的過程。各國在此問題上可以吸取過去成功軍控的案例經驗,加強彼此對該問題的共識和信任。中國常駐聯合國代表張軍在安理會上提出的關于人工智能治理的五條原則中,強調了堅持和平利用的重要性。這對于防范人工智能的軍事化加劇,具有很強的現實意義。畢竟,人工智能的軍事化應用是否會像核武器一樣對人類能夠產生毀滅性的影響的問題需要國際社會認真對待。

三是應加強關注人工智能的極端主義、恐怖主義擴散。新興技術向極端主義蔓延將會給各國帶來安全威脅。在此方面,各國應提升在打擊極端主義獲取人工智能技術方面的合作力度。這就要求政府間應加強信息共享、聯合執法、平臺監管等方面的合作,以及私營部門、技術社群等多利益攸關方群體對技術特性問題的共同關注。

安全內參

安全內參

D1Net

D1Net

E安全

E安全

一顆小胡椒

一顆小胡椒

安全牛

安全牛

一顆小胡椒

一顆小胡椒

一顆小胡椒

一顆小胡椒

E安全

E安全

安全圈

安全圈

GoUpSec

GoUpSec

中國信息安全

中國信息安全

中國信息安全

中國信息安全