從虛假信息到深度造假:網絡攻擊者如何操縱現實

近期,電視劇《狂飆》的爆火,激起了一些UP主的二創激情,將劇中的“CP”角色通過AI換臉移植到其他影視片段中,形成讓網友驚呼“眼前一黑”的戲劇化效果,同時也收獲了滿滿流量。乍一看這只是單純的娛樂行為,但有時諸如”AI換臉“等深度造假技術(Deepfakes)可不只是”逗你笑“這么簡單,背后的安全隱患不容忽視。

《狂飆》中安欣和高啟強的角色人臉被AI換臉至《西游記》女兒國的橋段中

什么是深度造假?

深度造假是指將真實圖像、視頻甚至音頻進行替換、偽造,以此可以實現對信息的操縱。要創建質量足以用于深度造假的音視頻,往往需要 AI(人工智能) 和 ML(機器學習)技術。使用這類技術不同于一般類型的信息操縱,不需要采取片面截取、屏蔽等方式來讓信息按自身的意圖傳遞,而是更加接近信息本源,以”貍貓換太子“的方式制作虛假內容,因此在技術上更加高階。Cato Networks 安全戰略高級總監 Etay Maor認為,現今AI 生成的文本(例如 GPT3)已經與深度偽造結合使用,以創建更具互動性、看起來像人類的對話機器人。

深度造假舉例

深度造假圍繞音視頻可以有各種形式,有些簡單,有些更高級。一下例舉一些時下流行的深度造假形式:

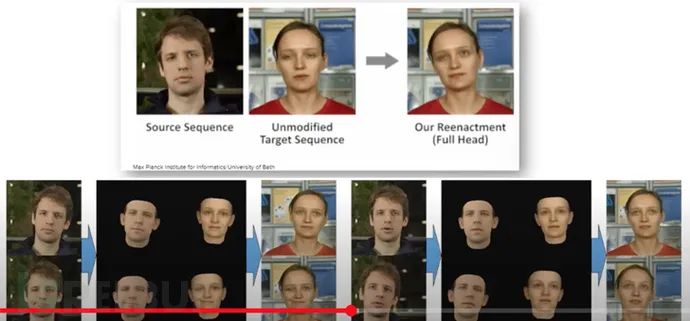

換臉

換臉是將視頻或圖像中的某個人臉替換為另一個人的行為。換臉需要專門的軟件,但不一定要基于先進的技術,一般人甚至可以找到支持換臉的移動應用程序。移動應用程序中可用的面部交換通常僅限于簡單的用例,例如在某電影場景中將用戶的照片和演員的面部進行交換。

而高級的換臉需要更多的模型訓練和代碼,因此需要 GPU,這既昂貴又占用資源。下方的視頻截圖展示了一個高級的換臉偽造示例,把著名影星湯姆·姆克魯斯的臉換在了視頻中的主播身上。

據悉,在這個例子中,需要在 GPU 上進行兩個小時的訓練以及幾天的專業視頻編輯后期處理。這還不是最復雜的,因為這名主播的聲音和發型與湯姆·姆克魯斯相似,從而適當減少了機器訓練和后期處理的工作量。

口型同步

口型同步又被稱為”木偶大師“(Puppet Master),是一種操縱口型圖像的技術,使人看起來好像在說他們實際上沒有說過的話。與換臉訓練模型相比,口型同步的技術基于合成面具,是在原始圖像的人物臉上訓練模型,特別是在嘴部動作上,并將其放置在模仿者的模型之上,并對他們進行口型同步。

音頻

這一類深度偽造類型基于音頻。Audio deep fakes 是一種音頻文件,它采用真人的聲音并使其聽起來像是在說他們從未說過的話。音頻深度偽造是通過獲取音頻文件、為聲音分配注釋、根據注釋訓練 ML 模型以將聲音與文本相關聯,進而生成新的音頻文件。

深度造假的網絡風險

目前,深度造假的效果正越來越達到以假亂真的地步,進行造假的方法也變得更加容易而,且創建速度也比以往任何時候都快。這使深度造假在網絡上成為強大的武器化工具,可用于社會工程、欺詐、威脅等網絡犯罪行為,進而對企業甚至國家構成安全風險。比如用來模仿 CEO 的聲音,并說服一位高管將數十萬美元匯到一個詐騙賬戶。

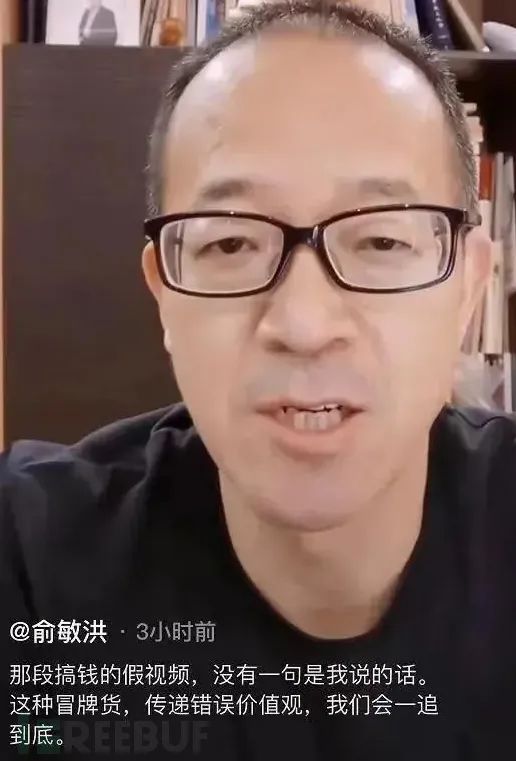

深度造假也可用于傳播虛假信息,以影響公眾輿論或掩蓋真相。往小了說,這會對個人聲譽和形象構成侵犯,比如2021年底,國內一段以“搞錢萬能論”為主題的視頻在網絡上瘋狂傳播。乍一看,這段言論竟出自是新東方教育科技集團董事長俞敏洪。但隨后俞敏洪就通過其個人社交帳號發布了辟謠視頻,他表示搞錢視頻里的話沒有一句是自己說的。而隨后也證實這段視頻是通過語音合成技術生成。

往大了說,深度造假可用于冒充國家領導人并引發國家沖突。據ASI數據科學公司曾經做過的一項測試,通過音頻生成算法,只需要借助兩小時的語料并訓練五天時間,就可以模擬出一份以假亂真的特朗普向俄羅斯宣戰的語音。

在其他情況下,深度造假可以實現似是而非的否認,大眾可以通過聲稱它們是深度造假來否認所有媒體來源,從而造成對社會信任的嚴重破壞。

如何檢測深度造假

初級檢測方法

初級檢測方法依賴于 ML 模型,這些模型經過訓練可以識別通過深度偽造生成的偽影或像素化。人眼可能無法察覺這些偽影,但在真實圖像和深度偽造圖像上訓練的模型能夠對其進行檢測。

高級檢測方法

高級檢測方法使用可以識別語義上有意義特征的模型,包括不自然的動作,如眨眼、頭部姿勢或獨特的舉止,以及音素-語音的不匹配。

雖然這些檢測方法目前被認為是準確的,但隨著深度造假技術的改進以及復雜度的加深,預計這些檢測效果將會有所折扣,需要更新和改進。

除了這些技術之外,大眾都可以通過驗證自己收到的音視頻來源,以幫助檢測深度造假。