機器學習:安全還是威脅?

機器學習算法已經成為網絡安全技術的一個關鍵部分,目前用于識別惡意軟件,減少警報數量,幫助漏洞修補的優先級。然而,研究機器學習或人工智能安全的專家卻警告,這些AI算法可能會被攻擊者顛覆。

在去年發表的一篇研究論文(邪惡模型:在神經網絡模型中隱藏惡意軟件)中,研究人員發現,神經網絡的冗余特性可以讓攻擊者將數據隱藏在一個普通的神經網絡文件中,占用文件大小的20%,而不會顯著影響模型的性能。在2019年發表的另一篇論文研究表明,受到入侵的訓練服務可以在神經網絡中創建一個后門,并持續存在,即使該神經網絡被用于另一項任務的訓練。

Berryville機器學習研究所聯合創始人兼首席執行官Gary McGraw認為,雖然這兩篇研究論文顯示了可能的威脅,最直接的風險就是竊取或修改數據。因為當人們把機密信息給到機器,以進行機器學習時,敏感數據通常可以從ML系統中恢復,這種系統往往以不安全的方式運行。當機器學習系統的查詢被暴露時,返回的結果通常就會暴露。這就是機器學習一個非常重要但卻被忽視了的問題,“數據非常重要”。但在網絡安全行業,人工智能和機器學習已成為營銷必備的功能,開發人員專注于利用人工智能技術創造新的用途,而忽視了人工智能本身的安全性。

McGraw認為,最大的風險在于數據。

對抗性機器學習

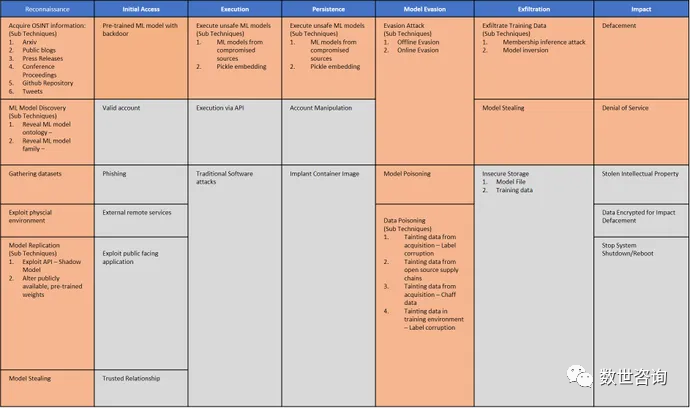

2020年,微軟、MITRE和其他主流科技公司發布了一份名為“對抗性機器學習威脅矩陣”的潛在攻擊目錄,該目錄最近更名為“人工智能系統的對抗性威脅環境”(ATLAS)。這個矩陣警告,企業要評估依賴AI或ML技術系統的潛在風險。比如在ML文件中隱藏數據,與普通風險幾乎沒有區別,本質上是重新創建了一種特殊形式的隱寫術。但我們必須注重ML系統的安全性測試,否則一旦被攻擊者所利用……

圖:對抗性機器學習威脅矩陣

Sophos的首席科學家Joshua Saxe認為,部分原因是安全人員大多關注的是眼前的攻擊,而不是難以實施的、未來的復雜攻擊。畢竟這類攻擊,基本上是人們想象出來的,他們認為攻擊者將來會采取的方法。然而,隨著越來越多的安全專業人員依賴機器學習來完成工作,對威脅環境的認識將變得愈加重要。

研究人員建立的對抗性攻擊,包括C2惡意流量、域名生成算法(DGA)和二進制惡意軟件的檢測逃逸等。現實生活中的攻擊案例,如2016年,微軟發布的聊天機器人Tay開始和人類聊天后,不到24小時就被教壞,成為一個集反猶太人、性別歧視、種族歧視于一身的“不良少女”。還有一次,VirusTotal被數據投毒,以逃避檢測。

Saxe認為,合成媒體(典型的如Deepfake)將是攻擊者在未來幾年中大量使用人工智能的領域。比如文本生成神經網絡GPT-3,可以用來生成網絡釣魚的文本,就像是人類發送的一樣。基于人工智能的人臉生成算法可以創建合成真實的人物相貌圖片。

“使用這項技術真的很容易。”

——Sophos首席科學家Joshua Saxe

雖然研究人員已經展示了多種可能的ML攻擊,但大多數攻擊手段的使用還需要數年之久,因為攻擊者的工具箱中仍然充斥著大量更為簡單易用的自動化工具,迄今為止這些工具仍然是成功的。必須阻止ML攻擊的兩個領域是機器人和自動駕駛汽車,否則這兩個領域根本無法普及。因為,機器人和自動駕駛不僅依賴算法運行,還需要將人工智能的決策轉化為實際行動。一旦入侵了這些算法,并影響行動決策,后果不堪設想。

兩篇論文地址:

https://arxiv.org/pdf/2107.08590.pdf

https://arxiv.org/pdf/1708.06733.pdf