12月8日,歐盟立法機構就《人工智能法案》達成初步政治協議[1]。這意味著盡管法案細節仍會有調整,但規制框架已基本確立。似曾相識的節點不禁讓人聯想起2015年12月,當時歐盟就GDPR(歐盟數據保護條例)文本達成一致,并在轉年批準通過法案,就此開啟GDPR時代。

AI時代,歐盟會繼續演繹“布魯塞爾效應”,復制下一個GDPR么?

“布魯塞爾效應”的神話

“布魯塞爾效應”最早由學者Anu Bradford[2]提出,是指:歐盟通過其單方面的市場規制能力,在無需他國家、國家機構協作的情況下,制定出全球市場遵循的規章制度。這種規則制定能力引領了全球商業環境的形成,導致許多全球商業重要方面的“歐洲化”。

在GDPR之前,“布魯塞爾效應”在化學品安全標準、航空業碳排放等領域都有成功案例。在數字經濟領域,人們熟知的GDPR,更是將“布魯塞爾效應”發揮到極致:

(一)推動各國立法向GDPR靠攏。GDPR推動了全球個人信息保護法的立法浪潮,并成為許多國家制定立法的第一參考,包括巴西、印度、日本、韓國、南非、阿根廷和肯尼亞等等。盡管英國不再是歐盟成員國,但仍頒布了與GDPR范式相同的立法;美國一直未出臺聯邦層面的隱私立法,但受GDPR影響,美國第一科技大州——加州也出臺了《加州消費者隱私法案》(CCPA),被稱之為美國小GDPR。中國2021年出臺的《個人信息保護法》也隨處可見GDPR的影子,甚至部分規范更加嚴苛[3];

(二)改造了跨國公司的數據合規體系。盡管仍有部分例外,全球跨國企業將GDPR作為主要的合規基準;

(三)在全球數據跨境流動中,各國爭取納入歐盟“白名單”,為本國企業建立穩定的數據跨境流動渠道。日本、韓國、印度等均積極申請歐盟的“白名單”認證。美國也一次次通過安全港(2000)、隱私盾(2016)、隱私框架(2023),與歐盟達成雙邊協議,以更加全面的保護承諾尋求歐盟的認可。

歷史的車輪來到AI時代。在達成協議之后,歐盟議會發布稱:歐盟《AI ACT》可以像GDPR一樣,為其他司法管轄區的人工智能監管制定全球標準,在世界舞臺上推廣歐洲的技術監管方式。

歐盟《AI ACT》

依舊延續GDPR系統的基本風格

歐盟《AI ACT》是目前為止最為全面系統的人工智能法案。

盡管部分國家在AI的部分應用場景,如自動駕駛、人臉識別領域已出臺相關法律規范;我國也在今年7月頒布《生成式人工智能服務管理暫行辦法》規章,但以上規范只是側重于AI在某一行業或領域內的應用,與當前AI技術應用對社會帶來的廣泛深入的影響相比,只是管中窺豹。

縱觀歐盟《人工智能法》,從法規體系性來看,尚未有出其右者。簡言之有三個方面:橫向立法模式,全生態主體與多元化議題。

(一)橫向立法模式

如同GDPR一樣,歐盟《人工智能法》采取了橫向立法模式,即適用于所有投放于歐盟市場或者在歐盟可使用的AI系統,可以覆蓋金融、醫療、內容、教育、能源、運輸、司法等各個行業領域;這顯然與美國更加偏好的區分行業領域的垂直立法模式有著顯著區別。

(二)全生態主體

其所確立的法律主體,覆蓋了AI產業全生態。

其中,主要市場主體包括:

1.提供者(Providers):是指開發人工智能系統,并以期以自己的名義投放市場或使用的實體(無論是付費還是免費)。它們負責確保其系統符合法案的要求,尤其是在安全性、透明度和尊重基本權利方面。例如:OpenAI,Microsoft,Google,Meta等模型開發者;

2.部署者(Deployer):是指在其授權下,將人工智能系統實際應用于特定環境或場景中的實體。例如政府部門、金融、醫療、教育機構等等,他們將人工智能技術整合到產品、服務或運營流程中。部署者要確保他們使用的人工智能系統符合法定的風險管理和合規要求,對于被分類為高風險的AI系統,部署者還需要遵循更加嚴格的規定。

3.進口商和分銷商(Importer,Distributor):是指將歐盟之外的人工智能系統投放至歐盟市場,以及在供應鏈中的市場服務主體。例如:從非歐盟國家進口含有AI技術的電子產品,如智能家居設備、智能穿戴設備等。

《人工智能法》幾乎360度全景覆蓋了AI現有產業生態中各類主體,并為其量身匹配了不同的法定義務。同一個市場主體,在不同場景下,也可以兼具不同的法律身份。例如openAI作為大模型的開發者,是人工智能系統的提供者,同時它也是ChatGPT應用的部署者。

監管框架中的法定主體包括:

(1)各成員國主管機構(National Supervisory Authorities):負責在本國內適用和實施AI ACT;

(2)歐盟人工智能辦公室(AI Office,在歐盟委員會下設)。是歐盟層面的監督協調機構,主要由成員國主管機構派出的代表構成。類似當前GDPR實施機制中,歐盟EDPB(數據保護委員會)與各成員國監管機構的關系。

(3)歐盟及其成員國現有的其他監管機構。如歐盟央行、數據保護監管機構(EDPB),各成員國中的各行業、各領域涉及人工智能系統的監管機構,如交通、醫療、教育等部門,《AI ACT》有專門篇幅涉及以上機構及其現有法規的協調。

(三)多元化議題

基于風險的規制思路,使得歐盟《AI ACT》幾乎囊括了目前可見的,AI對于人類及社會發展帶來的所有風險議題,包括:

1.個人基本權利:包括健康與生命安全、公平不被歧視,操縱、隱私保護等等;

2.民主法治原則:例如:關于在公共場合中應用遠程適時人臉識別是否應當被完全禁止的議題,主要是從對民主法治原則出發的考慮;

3.內容治理:包括對生成內容的合法性的基本要求,其中版權問題交由歐盟版權法體系安排;

4.產品安全:AI系統被嵌入產品服務中產生的安全問題,除了法案作出一些基本要求(技術文檔、質量管理體系、一致性評估等),還涉及與現有的產品安全立法的協調,法案專門以附件形式列出了需要協調的立法清單,包括了民用航空、機動車、海洋設備、醫療設備、鐵路系統、玩具、電梯等等;

5.能源效率與環境保護:歐盟對環保話題的高度關注,在人工智能法中亦有體現。法案指出:為了更好地理解人工智能系統對環境的影響,提供者起草的技術文件應包括人工智能系統的能源消耗信息,包括開發期間的消耗和使用期間的預期消耗。

6.就業與勞動保護等多個議題。

當然以上問題并非均由《人工智能法》一部法律來回應,因此,法案專門以附件形式列出了需要與之協調的現有法律清單,這更加凸顯了《AI法案》作為綜合性立法的特征。

但能否復制GDPR模式,顯然不能僅僅依靠大而全的法律體系,以及已經備受爭議的域外效力,而是能否做到俯身探究技術原理與產業生態,在把握發展規律的前提下,開出治理良方。

Source:歐盟委員會

能否引領全球AI治理,取決于

《AI ACT》是否足夠開放包容

與GDPR時代相比,當前圍繞AI的國際治理存在顯著的差異點:

(一)技術飛越及其帶來的挑戰,已經從量變轉變為質變

從1995歐盟數據保護指令到2016 GDPR的二十年間,技術產業從桌面互聯網發展至移動互聯網,對于個人信息的收集處理的范圍、頻度、深度雖然呈現指數級的增長,但在本質上,其并沒有顛覆數據處理的基本范式,只是更加規模化。因此作為95指令的增強版本,GDPR引入了更全面的用戶權利,更嚴苛的合規標準,更有威懾力的處罰,滿足了來自用戶的權利主張和監管的干預需求,也成就了GDPR自身。

但在AI時代,特別是過去兩年所經歷的基于LLM大模型的AI技術突破式發展,人類從未如此接近通用人工智能(AGI)。通過AGI與各場景的結合,人類即將開啟人機協作與技術創新的新范式,進而對經濟和社會演化帶來躍遷式影響。每個個體,每個行業都將全面迎接人工智能技術革命,改造原有的認知與行動方式,挑戰前所未有。

(二)對此,包括歐盟在內的全球各國并沒有相應的規制積累

最典型的是,在2021年4月,歐委會提出人工智能法草案時,基礎模型概念甚至尚未浮現。直至2023年3月GPT 4橫空出世,歐盟加速審議《AI ACT》,才就是否引入“基礎模型”展開辯論,這一議題也隨即成為AI法案中最為焦灼的議題之一。

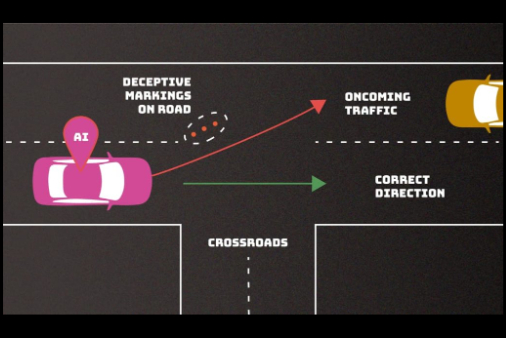

基礎模型對《人工智能法》“基于風險”的規制框架提出了直接挑戰。參照其價值觀體系,歐盟將AI系統按照風險等級區分為四類:不可接受之風險(禁止類),高風險(配置法定義務),有限風險(配置輕度透明性義務)。低風險(豁免適用)。而基礎模型的特點是:其AI能力具有通用性,可以被應用在任何領域,那么模型開發者與模型部署者究竟如何劃分責任?

2023年10月,歐盟立法三方就基礎模型的監管達成初步一致,但11月來,法國、德國、意大利等至少五個成員國開始提出不應對基礎模型施加任何監管的要求,以期對本國正處于發展之中的AI公司(如法國Mistral,德國Aleph Alpha)予以保護。12月會談達成一致的AI法案中最終采取了差異化規制方式,對基礎模型進行了分層,引入了具有高影響力的通用人工智能模型概念。目前雖尚未看到最終法案文本細節,但可以預測,基于基礎模型的復雜性,法案應當保留了相當大的彈性空間。

(三)全球層面的規制協調更為迫切

目前,AI技術僅在少數國家出現了跨越式突破發展,AI治理的國際協作顯得尤為重要。正如OpenAI CEO Sam Altman所呼吁:AI應像“原子能事務”一樣,需要在聯合國設立協調機構。

此次歐盟AI立法也關注到了與國際規則的協調一致問題,以確保法律的協調性與廣泛認可。為此AI ACT專門修改了“人工智能”定義,以與OECD保持一致。“人工智能”:是指基于機器的系統,它被設計為以不同程度的自主性運行,并且可以為了明確或隱含的目標,產生諸如預測、建議或決定等影響物理或虛擬環境的產出。該定義抓住了人工智能”自主性”的關鍵特征,以便將其與更簡單的軟件系統或編程方法區分開來。在歐盟推進《AI ACT》的同時,歐盟與美國也通過美歐貿易和技術委員會,來推進AI治理的相互協作。

(四)歐盟能否在GDPR中汲取經驗教訓,是《AI ACT》成功與否的關鍵

在以上具有明顯差異的歷史背景下,歐盟《AI ACT》能否延續歐盟影響力的關鍵性因素是其是否足夠開放包容,特別是汲取GDPR的經驗教訓,為技術創新和產業發展留有足夠空間。

眾所周知,歐盟在維護人類基本權利方面,是不遺余力的,但這也導致在另一方面,歐盟所設置的規則過于理想化,與技術產業脫節嚴重。有越來越多的現象和實證數據顯示,GDPR實施對于歐盟數字經濟競爭力帶來了顯著的負面效應。美國經濟學研究機構NBER發布了權威研究報告數據表明,僅GDPR生效的半年間,歐盟科技領域的中小企業在融資方面陷入下滑困境[4];而在同時,GDPR嚴苛的合規要求鞏固了大企業的市場地位,換言之,所謂“布魯塞爾效應”一定程度上是以歐盟市場作為了換取代價,這是歐盟立法者在打造GDPR之初時未曾預料到的。

審視歐盟《AI ACT》文本,可以看到歐盟立法者對規制的負面效應有所關注,試圖給技術創新更多的開放空間,例如:

1.明確對AI的科學研究、研發予以豁免。

2.為支持AI系統的發展,特別是出于減少AI負面偏差的目的,對處理敏感特殊數據的豁免。

以上兩方面,在GDPR中都未曾有考慮。

3.基于風險的規制思路,本身也反映了一種包容態度。將規制指向了高風險AI,而非所有AI。

4.明確引入監管沙盒。如企業遵循沙盒指導,將免于對條例違法行為的行政處罰。

5.作為審慎考慮的一部分,《AI ACT》延續了GDPR過渡期的做法,即在法案批準通過之后,仍舊給予2年時間才予以正式生效。也就是說,即使在最樂觀的情況下,《AI ACT》最早也是在2026年生效。

6.在立法過程中,注重與技術產業界的溝通,并積極采納建議。如在透明性方面,采納了數據卡、模型卡等最佳實踐范式。

值得一提的是:

7.在AI市場準入與安全管理中,歐盟繼續遵循了單一市場的基本要求,用一致性評估(Conformity Assessment,CA)體系代替行政許可。

作為產品安全與準入管理體系,一致性評估在歐盟有著悠久的歷史,也是歐盟內部市場的重要管理慣例。技術標準可以吸引更多的市場主體參與,避免行政機關的信息不對稱。特別是在歐盟單一市場背景下,通過透明的技術標準體系在一定程度上有助于防止各成員國通過行政手段對符合技術標準體系的AI系統或產品施加不合理的市場準入限制。在大部分情形下,廠商可以通過自我評估,表明符合歐盟技術要求,這顯著減輕了企業的合規負擔。

但總體來看,歐盟《AI ACT》目前設置的合規義務,其繁文縟節仍受到廣泛批評。高風險人工智能系統必須符合一系列要求:風險管理、數據治理、質量管理、基本權利影響評估,人工監督,售后市場監控系統等等。這些高規格的要求是否與當下的AI技術發展過于脫節,或者在AI發展初期就帶來過于沉重的負擔,尚需進行系統性的審視評估。

歐盟能否打破籠罩其上空20年之久——“產業落后,規制領先”的魔咒?

參考資料來源:

[1]https://www.consilium.europa.eu/en/press/press-releases/2023/12/09/artificial-intelligence-act-council-and-parliament-strike-a-deal-on-the-first-worldwide-rules-for-ai/

[2]Bradford,Anu(2012)."The Brussels Effect".Northwestern University Law Review.Columbia Law and Economics Working Paper No.533.107(1).SSRN 2770634

[3]王融,易泓清,騰訊研究院:中美歐個人信息保護法比較|附4萬字解讀報告,https://www.tisi.org/19493

[4]Jian Jia,Ginger Zhe Jin,Liad Wagman,THE SHORT-RUN EFFECTS OF GDPR ON TECHNOLOGY VENTURE INVESTMENT,NATIONAL BUREAU OF ECONOMIC RESEARCH,November 2018

ManageEngine卓豪

ManageEngine卓豪

Anna艷娜

Anna艷娜

尚思卓越

尚思卓越

尚思卓越

尚思卓越

Anna艷娜

Anna艷娜

X0_0X

X0_0X

X0_0X

X0_0X

Anna艷娜

Anna艷娜

X0_0X

X0_0X

Andrew

Andrew