隨著政府、企業和個人對生成式人工智能技術安全性的擔憂與日俱增,人工智能和網絡安全行業正在加速推進和完善人工智能相關網絡安全配套標準和框架的擬定。

最近,谷歌宣布推出Secure AI Framework(SAIF),這是谷歌首個用于保護人工智能系統的概念框架。

谷歌是生成式AI聊天機器人Bard的開發者和所有者,也是AI研究實驗室DeepMind的母公司。該公司表示,跨公共和私營部門的框架對于AI技術健康發展至關重要,其新的框架概念是朝著這個方向邁出的重要一步。

谷歌指出,SAIF旨在幫助減輕AI系統特有的風險,例如模型盜竊、訓練數據中毒、通過即時注入進行惡意輸入以及從訓練數據中提取機密信息。谷歌在博客中寫道:“隨著AI功能越來越多地融入全球科技產品中,負責任的(安全)框架將變得更加重要。”

SAIF基于六大AI安全原則

谷歌的SAIF安全框架基于其開發網絡安全模型的經驗之上,例如軟件工件的協作供應鏈級別(SLSA)框架和BeyondCorp零信任框架,后者已經被許多組織采用。谷歌表示,SAIF基于六大核心安全原則:

- 將強大的安全基礎擴展到AI生態系統,包括利用默認安全的基礎設施保護。

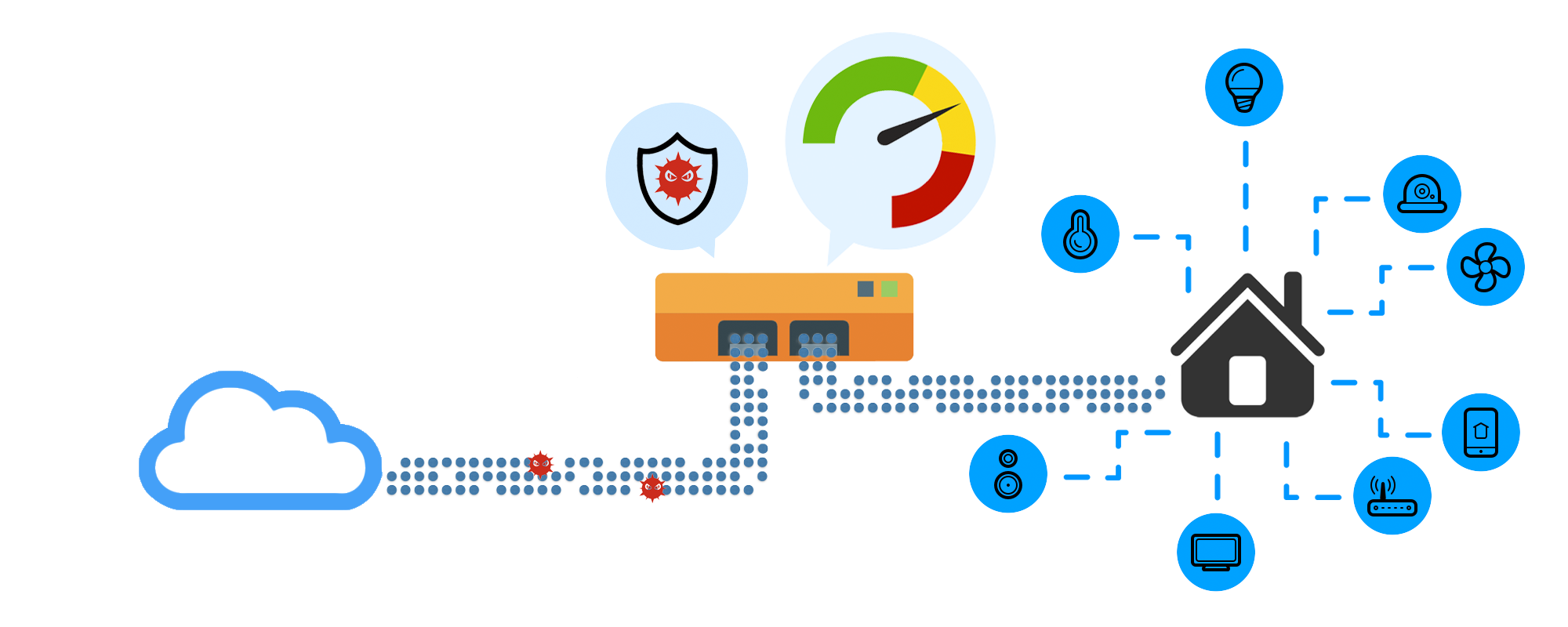

- 通過監控生成式AI系統的輸入和輸出來檢測異常,并使用威脅情報來預測攻擊,將擴展檢測和響應(XDR)的防護范圍擴展到覆蓋AI系統。

- 利用自動化防御技術跟上現有和新威脅的步伐,提高安全事件響應的規模和速度。

- 協調平臺級控制以確保一致的安全性,包括將默認安全保護擴展到Vertex AI和Security AI Workbench等AI平臺,并將控制和保護整合到軟件開發生命周期中。

- 通過基于事件和用戶反饋的強化學習等技術,加快AI系統威脅的緩解措施,并創建更快的反饋循環。

- 將AI系統風險與業務流程相關聯,包括評估端到端業務風險,例如數據歸屬、驗證和某些類型應用程序的行為監控。

推動其他AI風險管理框架和標準

除了SAIF以外,谷歌還列出了它正在參與和推動的其他AI安全框架和標準。其中包括幫助開發NIST AI風險管理框架和ISO/IEC 42001 AI管理系統標準(行業首個AI認證標準)。谷歌還表示將直接與包括客戶和政府在內的組織合作,幫助他們了解如何評估人工智能安全風險并減輕這些風險。

此外,谷歌將分享其威脅情報團隊(如Mandiant和TAG)對涉及AI系統的網絡活動的見解,同時擴大其漏洞獵人計劃(包括其漏洞賞金計劃)以激勵AI安全和保障的相關研究。最后,谷歌將繼續與GitLab和Cohesity等合作伙伴一起提供安全的AI產品,并進一步開發新功能以幫助客戶開發安全的AI系統。

大語言模型的十大漏洞

在谷歌發布SAIF之前不久,開放式全球應用程序安全項目(OWASP)上周發布了大型語言模型(LLM)的10大嚴重漏洞列表,OWASP指出大多數生成式AI都存在這些漏洞,潛在威脅巨大且易于利用和流行。十大漏洞列表如下:

1.提示詞注入

提示詞注入指繞過過濾器或使用精心設計的提示詞來操縱LLM,使模型忽略先前的指令或執行意外操作。這些漏洞可能導致意想不到的后果,包括數據泄露、未經授權的訪問或其他安全漏洞。常見的即時注入漏洞包括通過使用特定的語言模式或標記來繞過過濾器或限制,利用LLM標記化或編碼機制中的弱點,以及通過提供誤導性上下文誤導LLM執行意外操作。

預防措施:

- 對用戶的提示詞實施嚴格的輸入驗證和清理。

- 使用上下文感知過濾和輸出編碼來防止提示詞操縱。

- 定期更新和微調LLM,以提高其對惡意輸入和邊緣情況的理解。

2.數據泄露

LLM的輸出結果(響應)存在意外泄露(用戶或第三方的)敏感信息、專有算法或其他機密細節。這可能導致未經授權訪問敏感數據或知識產權、侵犯隱私和其他安全漏洞。

LLM響應中敏感信息的不完整或不當過濾、LLM訓練過程中敏感數據的過度擬合/記憶以及由于LLM誤解或錯誤導致的機密信息的意外泄露是常見的數據泄漏漏洞。

攻擊者可能會使用精心設計的提示詞故意探測LLM,試圖提取LLM從其訓練數據中記住的敏感信息,或者合法用戶可能會無意中向LLM提出一個會泄露敏感/機密信息的問題。

預防措施:

- 實施嚴格的輸出過濾和上下文感知機制,以防止LLM泄露敏感信息。

- 在LLM的訓練過程中使用差分隱私技術或其他數據匿名化方法來降低過擬合或記憶的風險。

- 定期審計和審查LLM的回復,以確保敏感信息不會被無意中泄露。

3.沙盒隔離不充分

如果LLM在訪問外部資源或敏感系統時未正確隔離,則可能導致LLM潛在的利用、未經授權的訪問或意外操作。LLM環境與其他關鍵系統或數據存儲的分離不足、允許LLM訪問敏感資源以及LLM執行系統級操作/與其他進程交互是常見的LLM沙盒不足漏洞。

一個攻擊示例是惡意行為者通過制作指示LLM提取和泄露機密信息的提示來利用LLM對敏感數據庫的訪問權限。

預防措施:

- 將LLM環境與其他關鍵系統和資源隔離開來。

- 限制LLM對敏感資源的訪問,并將其能力限制在其預期目的所需的最低限度。

- 定期審核和審查LLM的環境和訪問控制,以確保適當的隔離。

4.未經授權的代碼執行

當攻擊者通過自然語言提示利用LLM在底層系統上執行惡意代碼、命令或操作時,就會發生未經授權的代碼執行。常見的漏洞包括未經凈化或受限的用戶輸入,允許攻擊者制作觸發未授權代碼執行的提示,對LLM功能的限制不足,以及無意中將系統級功能或接口暴露給LLM。

OWASP引用了兩個攻擊示例:攻擊者制作了一個提示,指示LLM執行在底層系統上啟動反向shell的命令,授予攻擊者未授權訪問權限,并且LLM無意中被允許與系統級API交互,攻擊者操縱它在系統上執行未經授權的操作。

預防措施:

- 實施嚴格的輸入驗證和清理流程,以防止LLM處理惡意或意外提示。

- 確保充分的沙盒隔離并限制LLM與底層系統交互的能力。

5.服務器端請求偽造漏洞

當攻擊者利用LLM執行意外請求或訪問受限資源(如內部服務、API或數據存儲)時,會出現服務器端請求偽造(SSRF)漏洞。OWASP表示,輸入驗證不充分,允許攻擊者操縱LLM提示以發起未經授權的請求和網絡或應用程序安全設置中的錯誤配置,將內部資源暴露給LLM,這些都是常見的SSRF漏洞。

要執行攻擊,攻擊者可以制作一個提示,指示LLM向內部服務發出請求,繞過訪問控制并獲得對敏感信息的未授權訪問。他們還可以利用應用程序安全設置中的錯誤配置,允許LLM與受限API交互,訪問或修改敏感數據。

預防措施:

- 實施嚴格的輸入驗證和清理,以防止惡意或意外提示發起未經授權的請求。

- 定期審核和審查網絡/應用程序安全設置,以確保內部資源不會無意中暴露給LLM。

6.過度依賴LLM生成的內容

過度依賴LLM生成的內容會導致誤導性或不正確信息的傳播,減少決策制定中的人力投入,并減少批判性思維。組織和用戶可能會在未經驗證的情況下信任LLM生成的內容,從而導致錯誤、誤解或意外后果。與過度依賴LLM生成的內容相關的常見問題包括在未經驗證的情況下接受LLM生成的內容作為事實,以及在沒有人工輸入或監督的情況下依賴LLM生成的內容做出關鍵決策。

例如,如果一家公司依賴LLM生成安全報告和分析,而LLM生成的報告包含公司用來做出關鍵安全決策的不正確數據,則可能會因依賴LLM生成的不準確內容而產生重大影響。Omdia網絡安全高級首席分析師Rik Turner將此稱為LLM幻覺。

7.AI對齊不足

當LLM的目標和行為與預期用例不一致時,就會出現AI對齊不足,從而導致不良后果或漏洞。目標(參數)定義不當導致LLM優先考慮不良/有害行為、激勵函數失準或訓練數據產生意外模型行為,以及LLM行為的測試和驗證不足是常見問題。如果設計用于協助系統管理任務的LLM未對齊,它可能會執行有害命令或優先執行會降低系統性能或安全性的操作。

預防措施:

- 在設計和開發過程中定義LLM的目標和預期行為。

- 確保獎勵函數和訓練數據與預期結果一致,并且不鼓勵不良或有害行為。

- 定期測試和驗證LLM在各種場景、輸入和上下文中的行為,以識別和解決一致性問題。

8.訪問控制不足

當訪問控制或身份驗證機制未正確實施時,會出現訪問控制不足,從而允許未經授權的用戶與LLM交互并可能利用漏洞。未能對訪問LLM執行嚴格的身份驗證要求,基于角色的訪問控制(RBAC)實現不充分允許用戶執行超出其預期權限的操作,以及未能為LLM生成的內容和操作提供適當的訪問控制都是常見的例子。

OWASP給出的一個攻擊示例是惡意行為者由于身份驗證機制薄弱而獲得對LLM的未授權訪問權限,從而允許他們利用漏洞或操縱系統。

預防措施:

- 實施強大的身份驗證機制,例如多因素身份驗證(MFA),以確保只有授權用戶才能訪問LLM。

- 對LLM生成的內容和操作實施適當的訪問控制,以防止未經授權的訪問或操縱。

9.錯誤處理不當

當錯誤消息或調試信息以可能向攻擊者泄露敏感信息、系統詳細信息或潛在攻擊向量的方式公開時,就會發生錯誤處理不當漏洞。常見的錯誤處理漏洞包括通過錯誤消息暴露敏感信息或系統詳細信息、泄露可幫助攻擊者識別潛在漏洞或攻擊向量的調試信息,以及未能妥善處理錯誤,從而可能導致意外行為或系統崩潰。

例如,攻擊者可以利用LLM的錯誤消息來收集敏感信息或系統詳細信息,從而發起有針對性的攻擊或利用已知漏洞。或者開發人員可能會不小心將調試信息暴露在生產環境中,從而使攻擊者能夠識別系統中潛在的攻擊媒介或漏洞。

緩解措施:

- 實施適當的錯誤處理機制以確保錯誤被捕獲、記錄和處理。

- 確保錯誤消息和調試信息不會泄露敏感信息或系統詳細信息。考慮為用戶使用通用錯誤消息,同時為開發人員和管理員記錄詳細的錯誤信息。

10.訓練數據中毒

訓練數據中毒是指攻擊者操縱LLM的訓練數據或微調程序以引入可能損害模型安全性、有效性或道德行為的漏洞、后門或偏差。常見的訓練數據中毒問題包括通過惡意操縱訓練數據將后門或漏洞引入LLM,以及向LLM注入偏差,導致其產生有偏差或不適當的響應。

預防措施:

- 通過從可信來源獲取訓練數據并驗證其質量來確保訓練數據的完整性。

- 實施強大的數據清理和預處理技術,以消除訓練數據中的潛在漏洞或偏差。

- 使用監控和警報機制來檢測LLM中的異常行為或性能問題,出現這些問題可能意味著訓練數據中毒。

D1Net

D1Net

D1Net

D1Net

信息安全與通信保密雜志社

信息安全與通信保密雜志社

安全圈

安全圈

CNCERT國家工程研究中心

CNCERT國家工程研究中心

安全圈

安全圈

CNCERT國家工程研究中心

CNCERT國家工程研究中心

全球網絡安全資訊

全球網絡安全資訊

關鍵基礎設施安全應急響應中心

關鍵基礎設施安全應急響應中心

黑白之道

黑白之道

安全圈

安全圈

虹科網絡安全

虹科網絡安全